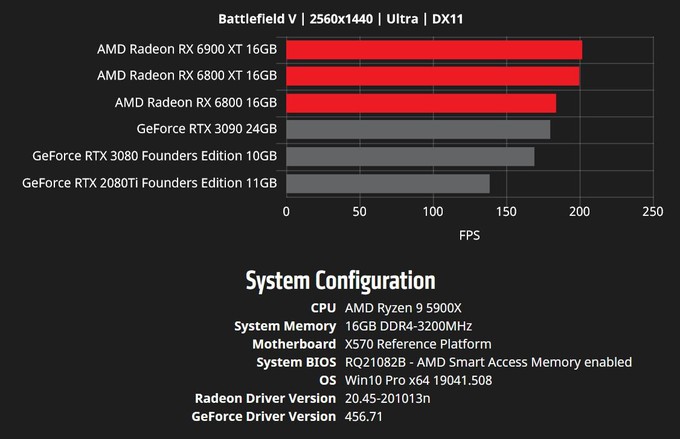

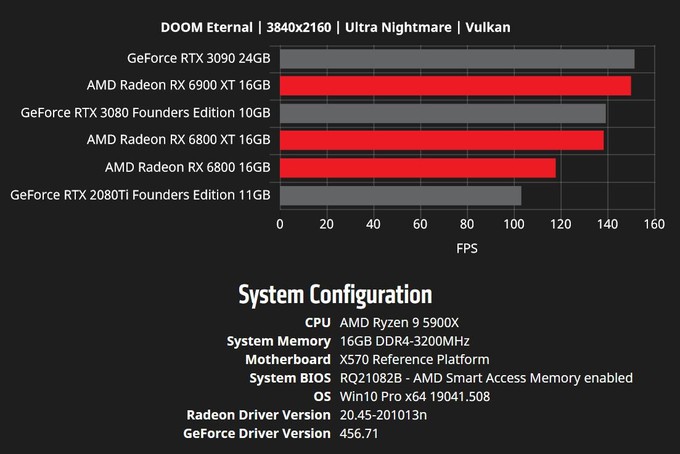

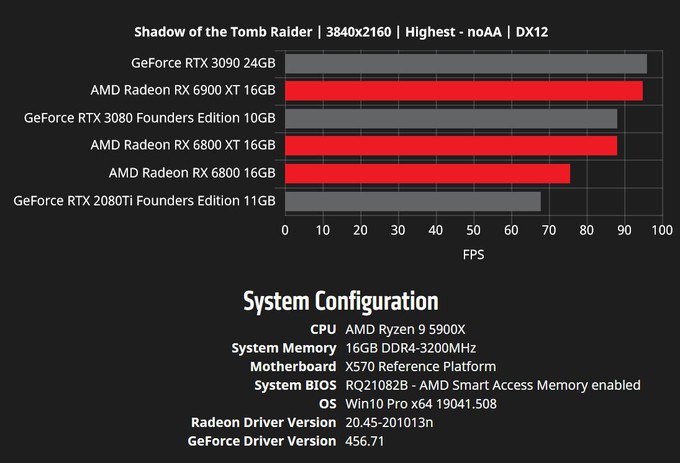

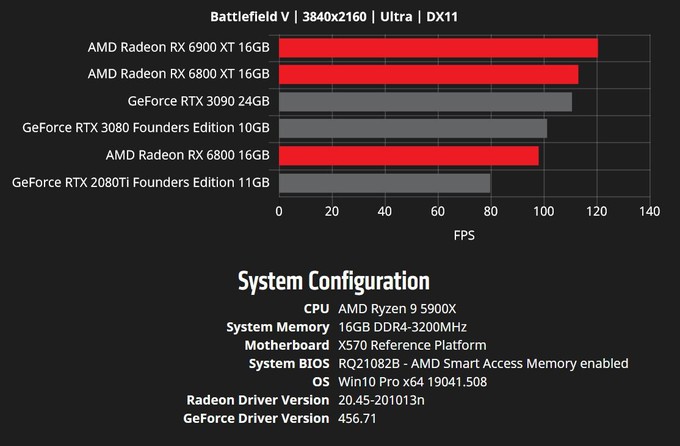

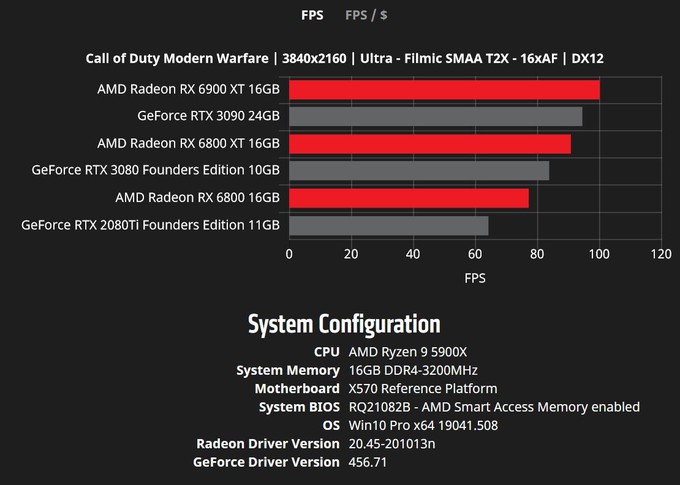

AMD показала преимущество новых карт перед NVIDIA в Battlefield 5, Doom Eternal, Shadow of the Tomb Raider и Modern Warfare

AMD опубликовала результаты нескольких тестов, призванных продемонстрировать мощь ее новых видеокарт в сравнении с конкурентом из NVIDIA.

В тестировании участвовали RX 6800, RX 6800 XT и RX 6900 XT, которые оказались почти везде быстрее, чем RTX 2080Ti, RTX 3080 и даже RTX 3090. А там, где последняя немного выигрывает, можно упомянуть ее астрономическую цену.

Во всех тестах была активирована технология Smart Access Memory, позволяющая CPU напрямую забирать данные из памяти GPU. Обратите внимание, что она работает только на связке из Ryzen 5000 и самых последних чипсетов 5000-серии.

Новое поколение карт AMD поступит в продажу 18 ноября.

в 12:06 03 ноя 2020

Пока карт не будет на руках у специалистов и не будет видео, они могут засунуть себе эти фейковые таблицы в мягкое место. Кто вообще спустя столько лет купиться на эти “тесты”?!

Как же любо дорого смотреть на подобные соревнования. Но меня интересует как там АМД с лучами работает? Поговаривают, что производительность 25-30% уступает Нвидиа, а поэтому все эти отыгранные у Нвидиа пару кадров могут оказаться в заднице в реальных играх.

Я не знаю, как у других, но у меня в городе 5700хт стоит, как 2070 супер, а 5600хт стоит, как 2060 супер. При всём при этом в картах нет лучей и они заметно горячее и почти такие же по производительности с конкурентами от “зелёных”. Я не вижу резона брать карты, кроме как из-за разницы в цене, которой просто нет.

В 2020 уже никто не верит тестам производителей, ибо на подлогах и откровенном вранье ловили и АМД, и НВидиа, и Интел и прочих.

Тестам не надо верить или не верить. Вера — удел глупых и наивных людей. Достаточно знать и понимать условия в которых эти тесты делались. И на этот раз информация по этим условиям в сети есть. А именно:

В сухом остатке мы имеем максимально оптимизированные условия тестирования оторванные от реальности. По факту, в реальности, таких цифр не будет. А потому хотелось бы сказать, что по факту цифр AMD ничем не лучше Nvidia, а может местами и хуже…

Но… есть одно важное “но” — цена. Если у меня будет выбор при покупке TOP’овых карт каждого из производителей и мне придется выбирать между разницей в цене в -500 баксов (AMD) или условными +10 FPS (Nvidia), то я безоговорочно выберу AMD, потому что этот никчёмный прирост, который обойдется мне в целых 500 бакинских, попросту этого не стоит.

А вот в дешевом сегменте не все так однозначно. Тут AMD сливается даже со всеми своими финтами ушами. И если я буду брать карту из новой линейки но в нижнем ценовом сегменте, то я отдам предпочтение Nvidia. Даже при условии необходимости выждать ее наличия, с чем у зеленых сейчас все очень туго.

Вот так, отметая ненужные терзания верований и не верований можно понять, что стоит брать, если есть такая возможность. Для этого совсем не надо быть Вангой, чтобы гадать, кто зап… заврался, а кто нет, кто правду говорит, а кто чешет не краснея (опачки, “красный” каламбур, внезапно). Достаточно просто ознакомится с имеющимися фактами и не делать поспешных выводом — удел школьников и недоумков.

Где ж моя 3080 по адекватной цене..

Звените товарищ “Учитель”.

П.С. Вам не кажется, что вы форумом ошиблись?

И тем не менее, три перечисленных пункта приняты тобою на веру. Если рассуждать в выбранном тобой ключе, то нужно проводить все тесты самостоятельно.

Верно говоришь! На форуме переводчиков безграмотность паащьряиться.

Достаточно посмотреть ютуб тесты из 3-4 источников “обычных” пользователей, а не довольствоваться рекламными плакатами. Они есть т.е. “люди” уже получили карты на руки? думается нет.

Сколько пели хвалебных од 5700(хт)? видеокарта когда вышла? чета я не вижу радостых возгласов сотен тысяч пользователей? почему все по прежнему предпочитают Нвидиа?

Сейчас даже прошивки SSD подстраивают под бенчмарки для красивых циферок:

Обзор NVMe-накопителя ADATA XPG SX8200 Pro

Вот интересно, тест AMDшных карт проведён в связке с, о чудо, AMDшным топовым процом на соответствующей материнке, на котором

Так почему карту NVIDIA пихают в ту же сборку, где априори показатели будут заведомо ниже? А если использовать “родную” связку Intel + nvidia на каком нибудь i9-10900 на ROG материнке и уже тут проводить какие то сравнения? Что то мне подсказывает, если не брать в расчёт цену, то результаты будут далеко не на стороне красных.

Ну таблички на AMD неплохо выглядят, у карт действительно есть производительность.

А там цена всех уравняет, если сделают дешевый аналог Нвидиа, к примеру без RTX, то почему бы и да. Платить оверпрайс за кирпич которому скоро второй БП нужен будет ради каких-то там лучиков такое себе удовольствие, АМД думаю есть что предложить.

Кому они будут нужны без лучей? Если сейчас эти самые лучи будут повально использовать.

Ну выход Xbox Series S вселяет надежды, что лучики еще останутся “опциональным” благом в будущих релизах. Не могут же Майки так недальновидно выпускать младшую консоль зажатую каким-то отдельным набором игр.

Могут и выпустили. Кастрат обыкновенный для которого специально никто ничего делать не будет. Просто будут отключать и все.

там есть лучи, внимательно читайте спецификации, всеми любимый 3Д Марк позволит сравнить подходы по лучам у разных производителей, + Годфол будет использовать данную технологию для построения теней (ролик с этим есть на данном ресурсе). + будет аналог DLSS, только не понято как оно будет реализовано, у той же нвидии отдельные тензорные ядра, но так как новые консоли особенно Х версия дружит с апскейлом, то все там +/- нормально судя по всему.

давайте перестанем гадать на кофейной гуще, дождемся выхода и тестов сторонних, а там уже будем делать выводы. лично я пока приостановил покупку 3070 до выхода 6800 по цене они не сильно отличаются, а запас по памяти 16 против 8 очень ощутимый. а учитывая что беру себе 5600х то связка может получить какой буст, но на все нужно посмотреть тесты.

Из тестов следует, кто сидит на Full HD 1920x1080 и кому хватает 60FPS, новые карты не нужны. Ну и опять же для тестов включают даже в старых играх, порой, самое крутое сглаживание и прочие плюшки, в реальности картинка не сильно улучшается, а жрать игра начинает ресурсов у видеокарты существенно больше.

Это ты внимательно читай кому и что отвечаешь. А то получается чукча писатель, а не читатель.

@rainmind простите барин, бес попутал, челом бьем

Не понял что ты хотел сказать?

2ergtrav

И что, я же писал, давайте включим на GTX1080 разрешение 4K (или 8K) ради сглаживания, а потом обратно в 1080p преобразуем, получим 40 кадров в секунду или меньше. Вы без такого сглаживания жить не можете? Вы ради него согласны 100 000 руб отдать? Ваш скириншот типичный развод. Выберите другие режимы тестирования, получите совсем другие результаты.

Если у создателей Dirt 5 руки из жопы растут, это еще не повод ради этой игры покупать RTX 3090.