Digital Foundry не советует играть в ПК-версию The Last of Us Part 1, если у вас нет видеокарты с 10+ гигабайтами видеопамяти

Digital Foundry выпустило часовой технический обзор The Last of Us Part 1 для ПК — специалисты остались в шоке от текущего состояния игры.

Дело в необоснованно высоких системных требованиях. По какой-то причине игра требует огромного количества видеопамяти, из-за чего страдают карты вроде RTX 3070.

30.03.2023 25 Iron Galaxy удалили из числа разработчиков ПК-порта The Last of Us Part 1

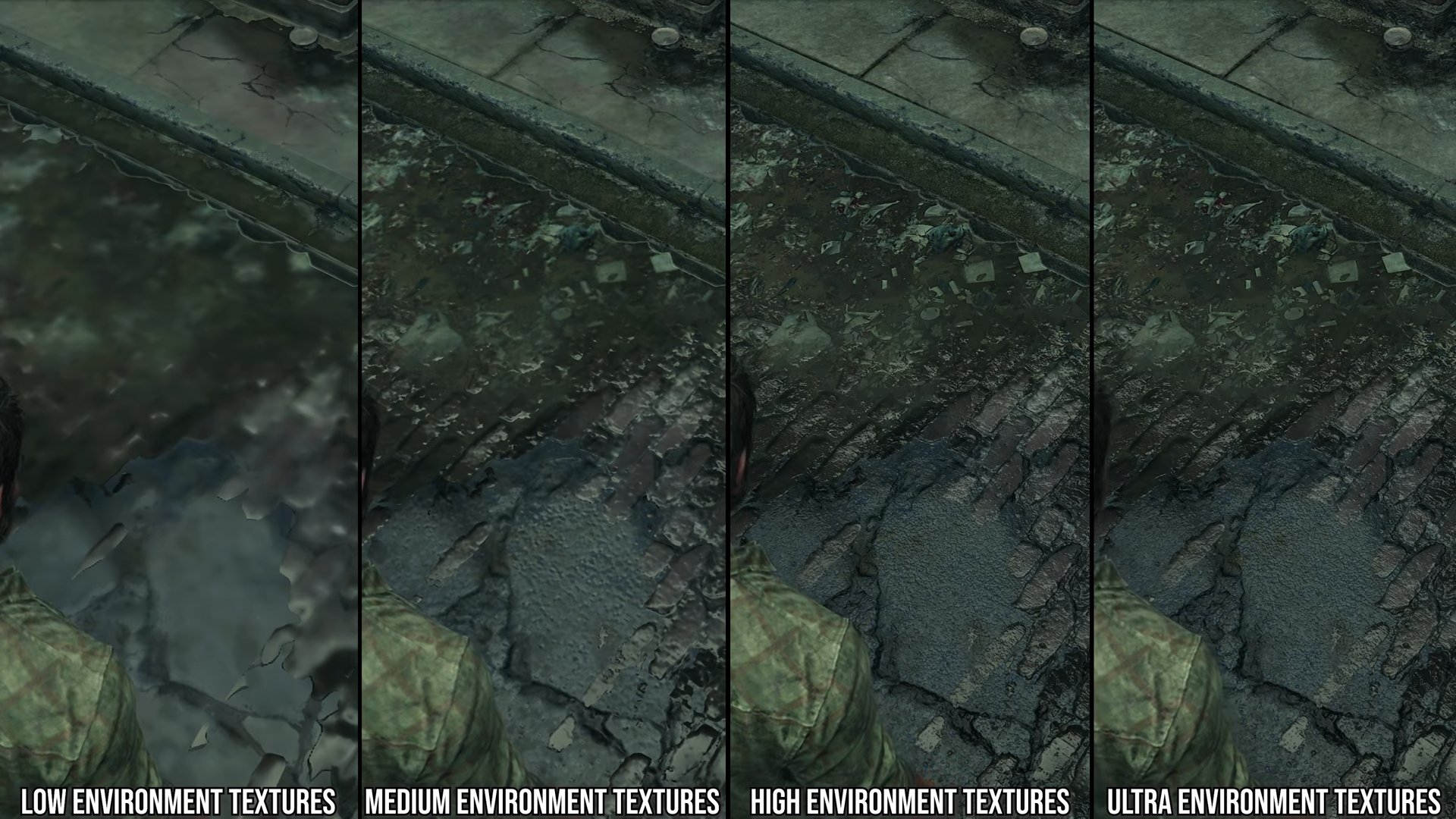

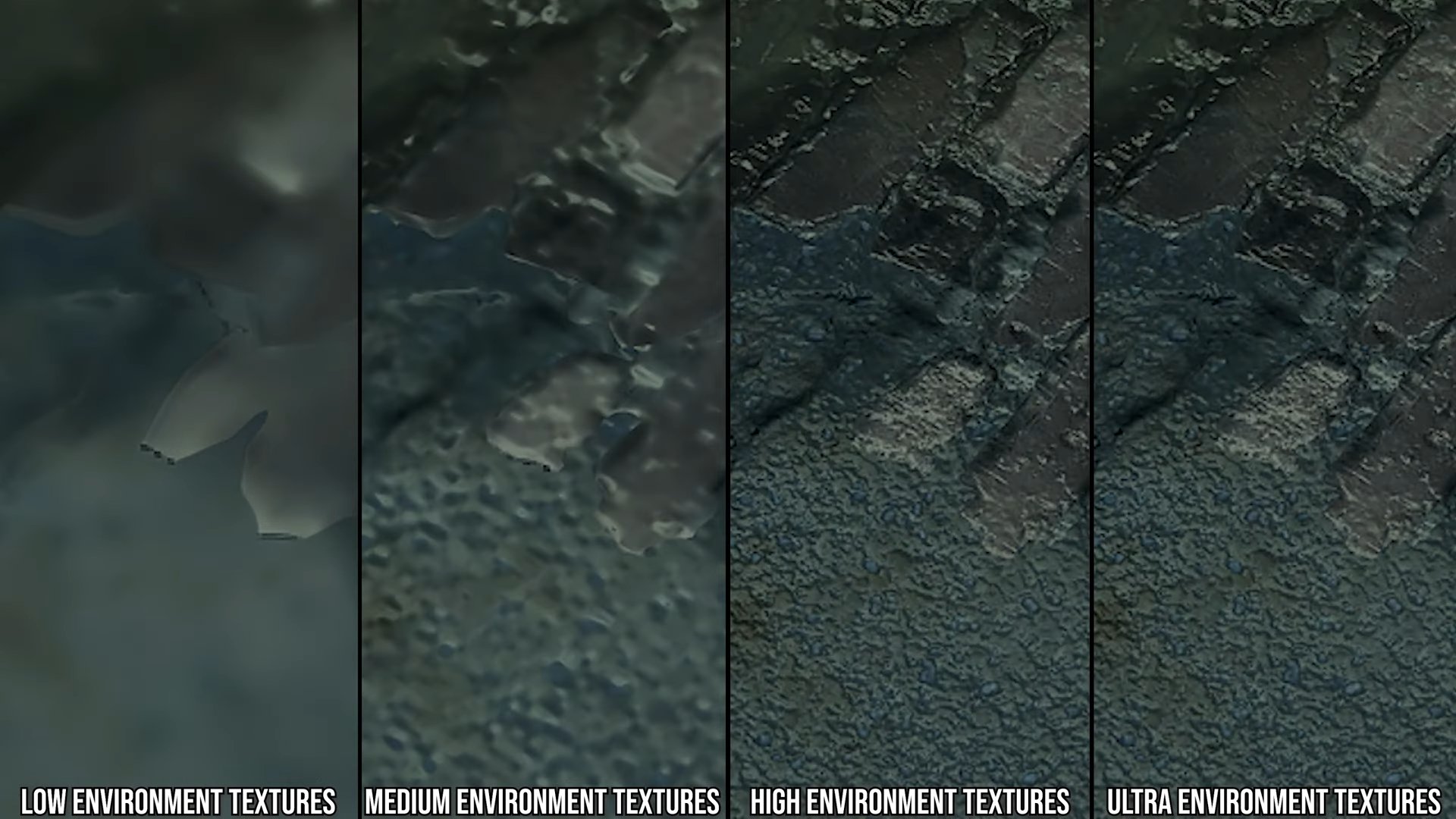

На них приходится играть с текстурами среднего качества, которые выглядят гораздо хуже «высокого».

Некоторые текстуры выглядят неплохо, но большинство необоснованно портят графику игры.

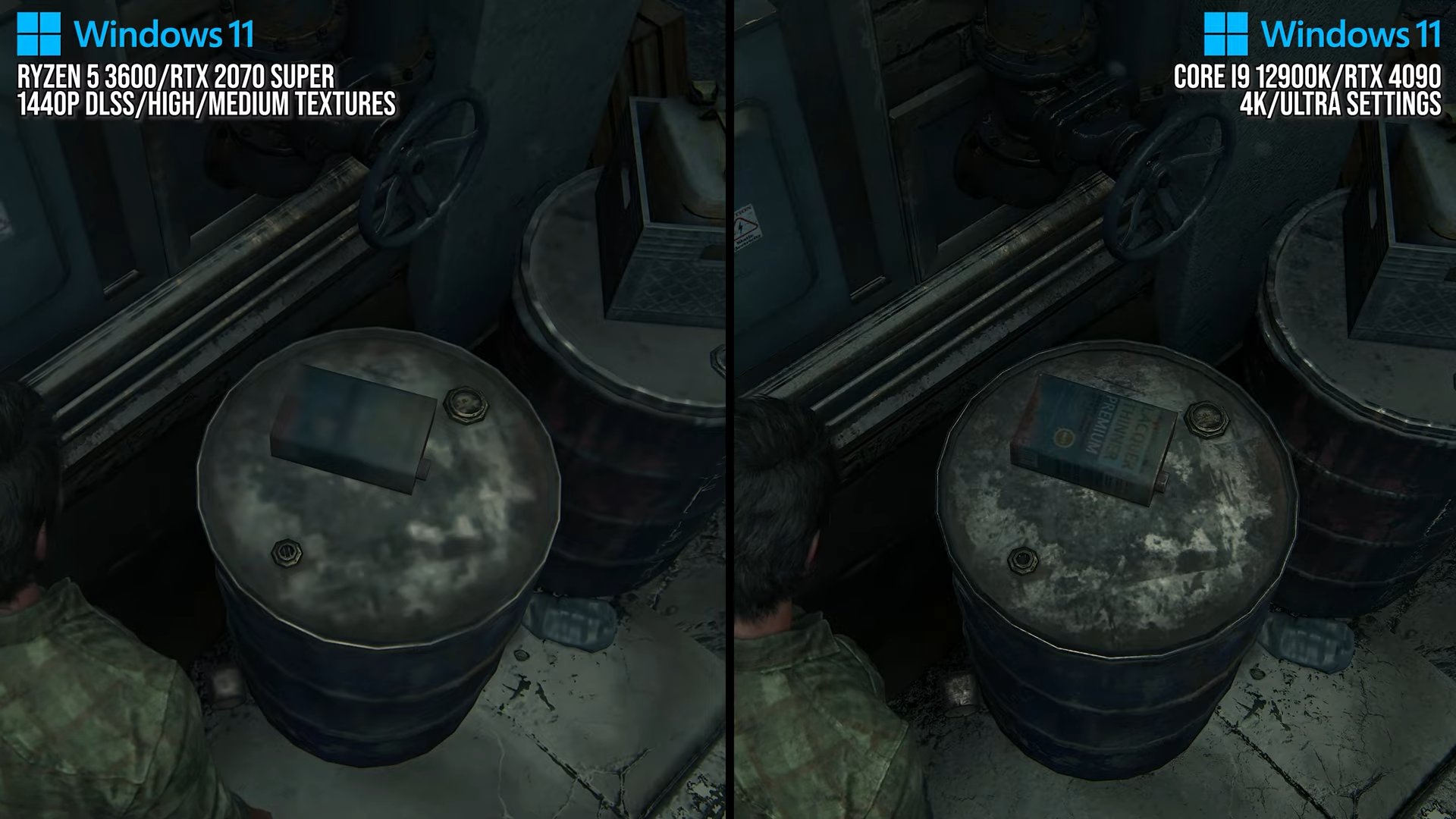

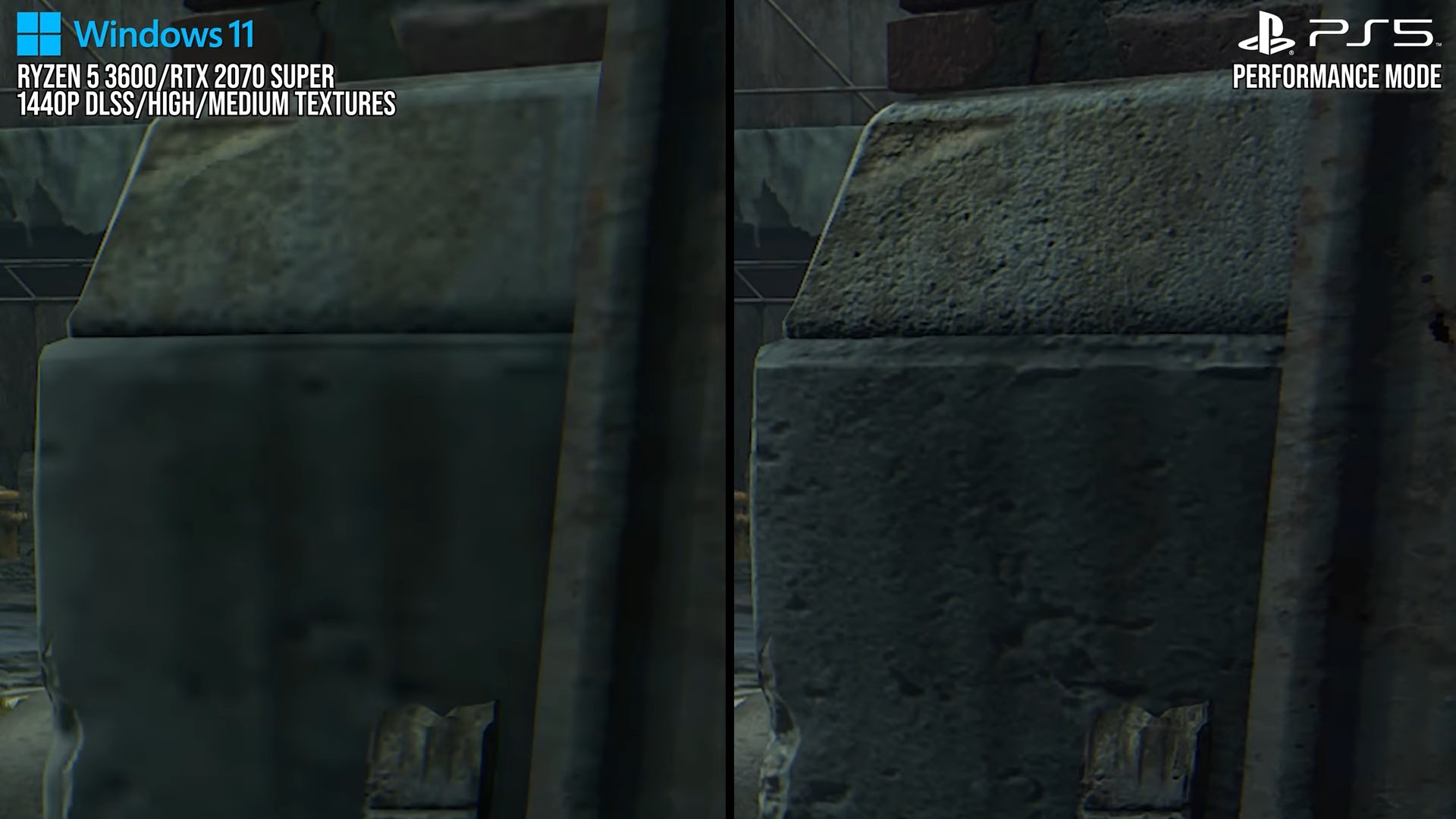

Из-за этого хорошо заметно, что на PS5 в режиме производительности игра выглядит лучше, чем на PC с видеокартой RTX 3070. В примере ниже левый скриншот сделан на RTX 2070 с тем же количеством видеопамяти.

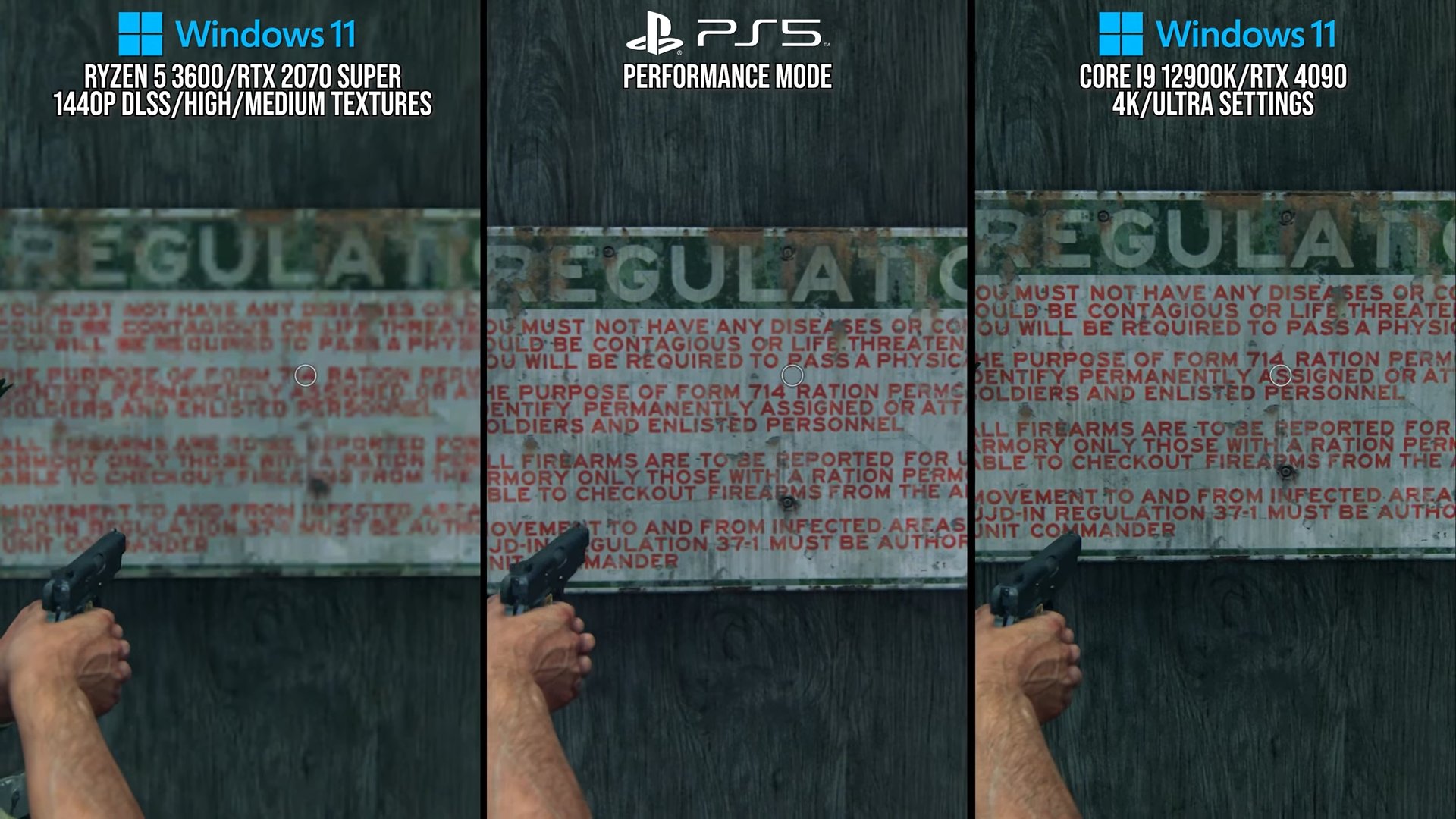

Из-за плохой работы с текстурами на некоторых из них просто невозможно ничего прочитать.

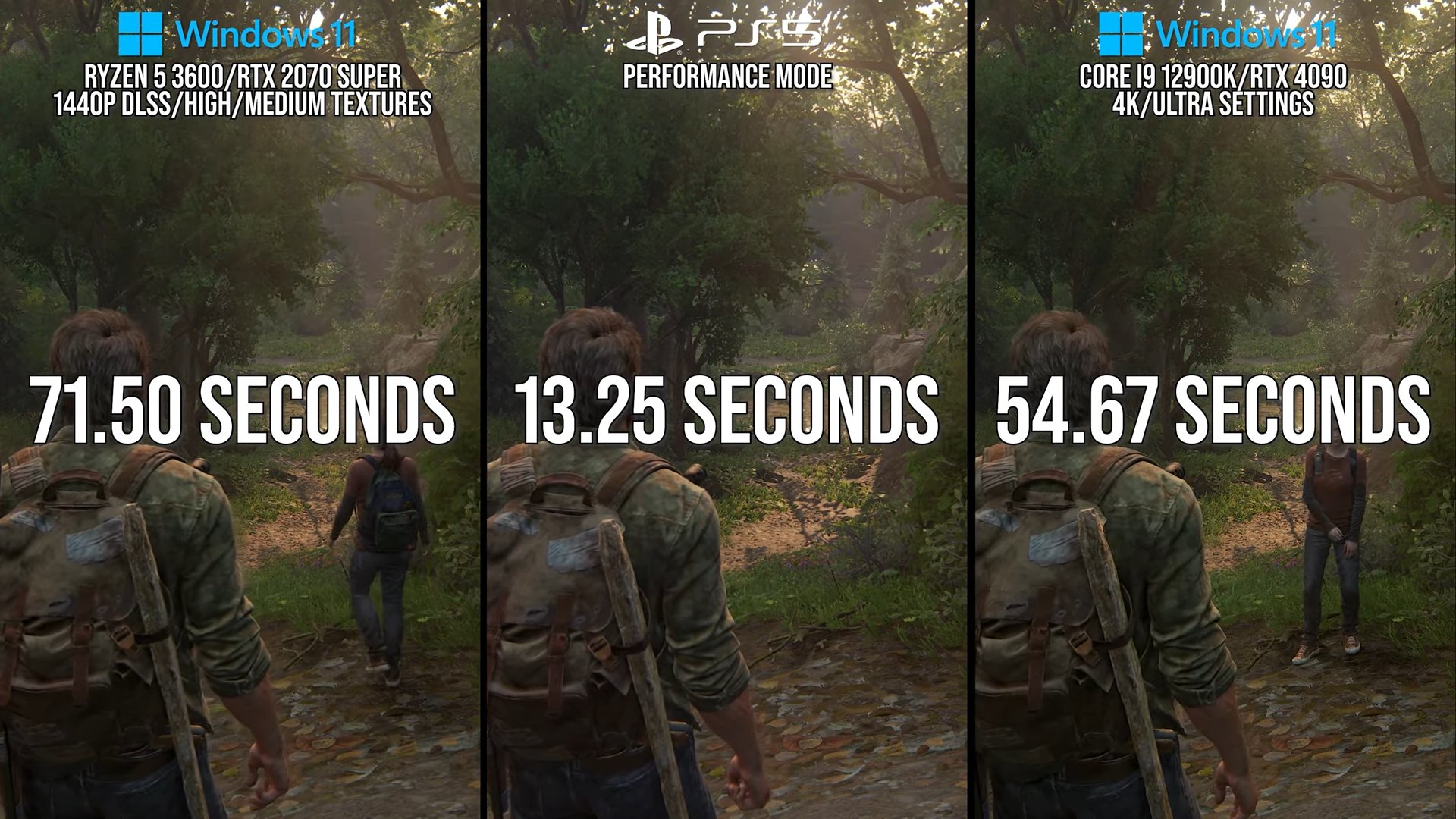

Вторая проблема — производительность. Игра по-прежнему страдает от статтеров — даже после выхода двух патчей. Ну и о компиляции шейдеров тоже нельзя не сказать — у тех, кому не повезло, она может длиться до часа.

Третья проблема — загрузки. То, что на PS5 игра загружается относительно быстро — известный факт, а на ПК время загрузки выше в 4-6 раз, что ненормально.

Специалисты сомневаются, что такие проблемы возможно оперативно исправить, и рекомендуют играть в The Last of Us Part 1 только на мощных ПК. И радоваться, если у вас RTX 2080 Ti, а не RTX 3070.

...именно за этот порт неприятно, т.к. именно эту игру ждали, официально, на ПК. Редиски криворукие- что тут ещё сказать? Доводите до ума, ребятушки!

Это просто какой-то кошмар. Игра на SSD грузится минуту, учитывая, что игра часто у меня вылетает, то перезапуск игры приходится по прилично времени ждать. Это выглядит очень дико, когда другие игры моментально грузятся. Такое ощущение игра не на SSD стоит, а на HDD.

Короче странный порт. У многих идёт плохо, у меня напр. можно сказать идеально, у человека с 6700k! и 3060(12gb), тоже хорошо идёт, и компиляция у него 45 минут была.

...как-бы не повторилась история, наподобие Batman: Arkham Knight. Понятное дело, что в итоге, всё получилось, но сколько всего было до этого...

В смысле, с отзывом копий? Cомневаюсь. Скорее всего, будут оперативно патчи клепать.

Так и конторка которая порт делала та же. Совпадение?

Так и конторка та же. Совпадение?

Играю на 3070+12700kf+32DDR5 в 1080p, почти все настройки на максимум, на фпс, статтеры и прочии подвисания не жалуюсь, в первый раз шейдеры компилировались минут 15 и за 10+ часов игры был один единственный вылет, ещё у Джоэла после пролога почему-то были волосы седые и низкотекстурные и пожалуй это все баги что я встретил, игра куплена в стиме.

Я не понял, 3070 получше чем 2080 будет.

Тоже чёт не понял, почему надо радоваться.

порт оказался жидким, такое быстро не отстирать… (фанатам и тем кто ждал — соболезнования, сам играть не буду, хайп огромный конечно но проект не цеплял уже на консолях, на пк ситуация та же)

...ну, там был вообще, практически, беспрецедентный случай.Но вот ждать оптимизацию, возможно, придётся долго. Тем более, что игру уже продали дважды, и что-то большие сомнения, что кто-то будет торопиться, в плане оптимизации на ПК. Искренне рад буду, если я ошибаюсь.

Объем видеопамяти: 8192 МБ против 11GB

...видимо, сначала ошиблись, в указании модели- бывает.

Понял.

@Trueman Ну да, бывает. Теперь начальный посыл новости понятен и сочетается с заключением.

Мой 3070ti ушла гулять

Мне вот интересно. Зачем ребята из данного видоса лочат фпс на 4090 до 60 кадров ? Боятся показать что 4090 может обделаться ? Зато на других картах что они показали лока нет. Сам сижу на 4080 и I9 9900(проц старова) у меня без лока фпс от 80 до 100.

Так совпало, что в момент этой истории с TLoU. Part I я задумался о замене видеокарты на 40хх серию. Не то чтобы очень нужно было, ибо 3070 сносно тянет почти всё, кроме RDR II, CP 2077 и Hogwarts Legacy, но… С этим портом моя красавица Ichill 3070 X4 высрала все свои внутренности, перемолов их четвёртым мини-кулером в процессе.

Через пару дней я стал счастливым обладателем Ichill RTX 4070 Ti 12GB и уже было успокоился. Ведь 12 гектар видеопамяти всяко должны были решить проблему. И каково же было моё разочарование? Не передать. Потому что игре на ультимативных “ультрах” мало и этого! Не то, чтобы неиграбельно, но 60 кадров, да ещё стабильных, в 2k я не увидел. Разумеется, без DLSS. С включённой технологией кадров стало побольше, но из-за нехватки видеопамяти и общей уже описанной ситуации с оптимизацией, игра всё равно работает нестабильно, фпс проседает и т.д.

О попытке запуска игры в нативном 4k и натуральном слайд-шоу что с DLSS, что без, можно не рассказывать. Не хотелось портить настроение от покупки недешёвого железа.

Про староват вопрос спорный у меня у самого такой проц, и в 2К я не видел ни одной игры которая его бы загружала больше чем на 45%...

В каком разрешении? 1440p?

В итоге поменял 3070 на карту уровня 3080ti. На мой взгляд шило на мыло, единственное поддержка DLSS3 теперь есть.

не согласен с этим. 4070ti кушает прилично меньше, тише и холоднее. заменой 3070 на 4070ti более чем доволен

Ну, 4070ti будет на 8% в среднем попроизводительнее в 1440p, а в 4k будут практически равны.

Тише, холоднее, энергоэффективнее… это всё понятно и здорово, но разница в производительности небольшая получилась.

Да...

Блин, извиняюсь, я выше какую-то херню написал. Я сравнивал 4070ti с 3080ti, а здесь же про 3070 речь. Безусловно это хорошая замена(3070 на 4070ti)

но без dlss?

Да вы вроде правильно написали 4070ti практически равна 3080ti в 4К, в 2к чуть лучше.

Я в своё время менял GTX 570 → GTX 1070 → 3080ti.

Сейчас планирую не меньше чем на 5000 серию переходить, если 3080ti раньше не сдохнет.

Не, я планирую с 3080ti переходить на 4080ti когда выйдет (ну или на 4090 ti), раньше смысла не вижу...

Это да, всё так. Я имею в виду, именно замена 3070 на 4070ti — это хороший ход. Cудя по тестам, там приличная разница получается.

Почему? 4090 уже сейчас продаётся.

Посмотрел тесты в 2к т.к. человек использует 2к разрешение, вывел среднюю разницу из 19 игр — получилось примерно 25%. Маловато как по мне.

Да у меня 2к монитор 144 герц. Кстати вот ещё особенность по поводу DLSS. Разница между качеством и балансом по фпс не какой. Ну край там 5-7 кадро. В режиме производительность чуть больше 100 фпс стабильно но страдает картинка. Вообще очень обидно что на пред топовой карте невозможно получить стабильные фпс больше 100 без ухищрений. Опять же почему не добавили генерацию кадров DLSS не понятно. Думаю с этой технологией на 40ХХ серии было бы получше.

@CyberEssence cлушай, ну я вот эти смотрел.

У меня получается 70-80(лок на 80)в 4k, стало быть в 1440p там около 150-ти должно быть, хотя я не проверял.

У вас в видео 3070ti.

Я тут брал только 2к разрешение, считал % разницы в каждой игре, потом суммировал все % и делил на кол-во игр (19) и получилось 24 с лишним %, ну пускай будет 25. Разница между некоторыми играми вообще небольшая, например Gears of War 5 — 6%, Flight Simulator — 5.5%, Far Cry ND — ~5%.

а зачем покупать 3080-3090 если есть 4070ti или 4080 для очень богатых =)

Не зачем конечно. На данный момент, если и покупать, то естественно 40-ую.

Да.

Запутался, мы говорим про разницу между 3070 и 4070ti? В видосе разница в среднем 40%(c 3070ti) Получается, c 3070 разница ещё больше будет. Правильно?

Прошел на пс5 на платину. Тормозов не было)

@piton4 Я ориентировался по ролику, который выложил.

3080 Ti везде хватает в 2К , осенью-зимой выпустят 4080-4090 ti вот тогда и будет смысл обновляться)

А, сейчас особо смысла не вижу)

Игра в среднем кушает 13Гб видеопамяти, что довольно не мало. Вообще с потреблением любой памяти, у игры какие-то зверские аппетиты, что оперативу кушает как не в себя, что видеопамять. При этом грузится как говно мамонта, почему? Хз.

Лучше не порти, а подожди нормальных патчей, где оптимизацию завезут, надеюсь. Сейчас игра играбельна только на 4080 и 4090, чтобы как бы охренеть как не дурно игра просит для комфортной игры.

Сейчас только ролик заметил. Насколько я вижу, в некоторых играх судя по цифрам, карта в 1440p простаивает. Без мониторинга непонятно, до упора ли загружена карта в 1440p\1080p

Всё-равно не понял, почему смысл появится именно потом, причин ждать 4080ti\4090ti, я не вижу, если уже 4090 продаётся.

Так если хватает, зачем вообще обновляться? Деньги то не малые. Я обновился, потому что конкретно не хватало производительности.

Очень сомнительный тест, я скажу. Тут тупо приводят цифры, не показывая самого геймплея. Насколько верны эти цифры? Это уже вопрос довольно занимательный. Как будто на презентации АМД и Нвидия, где тоже любят цифрами пестрить) Мне лучше живое сравнение, где картинка слева или справа, и желательно от авторитетного источника, а не от всяких ноунеймов, которые могут подтасовать данные, или провести тест как-нибудь неправильно.

А с чего обновлялся? Лично я обновлялся с RX580. А так можно каждый год обновляться. Как по мне карта должна служить как минимум одно поколение консолей.

Опоздали пацаны с ДФ, уже пройдено. Теперь можно совершенно спокойно ждать финального патча, чтобы пепепройти.

C 3090

На что?

Я раз в 2 года карту меняю, но не просто так, а именно по необходимости, не хватает.

@piton4 слушай, тебе бесплатно этот релиз подогнали? ну так уже облизываешь и идеализируешь в каждом топике о Ластухе этот кривой порт, прямо Логвинов, 12/10 на кончиках пальцев.

Берите выше, ему еще Сони за рекламу приплачивает.

Может и бесплатно.

Во первых мне нравится сама игра, почти по все аспектам. Во вторых, я писал только про оптимизацию, для меня этот порт практически идеальный c тех. части, и я знаю, что многие недовольны оптимизацией, но моё то отношение от этого не меняется.

Сейчас провёл ещё один тест, получив возможность посмотреть игру в обоих разрешениях и на обеих картах. Сильно распинаться не буду, чай тут не DTF.

Итак. Тестировал версию после второго патча. На всех возможных ультра-настройках. Мой первый пост был написан в теме на момент попытки поиграть в версию до патчей вообще, поэтому решил написать новый пост и внести ясность. В т.ч. ниже прояснить ситуацию с переходом на более новое поколение RTX со своей точки зрения.

RTX 3070. Разрешение 2k без DLSS. Около 25 фпс в стартовой сцене с дочкой Джоэла и 20-25 фпс в сцене с прогулкой по КЗ. Чем больше на экране событий и экшена, тем меньше кадров. За время теста 4 вылета из-за перегрузки видеопамяти.

RTX 3070. Разрешение 2k с DLSS. Стабильные 50-60 кадров в перечисленных выше сценах. Никаких вылетов, хотя видеопамяти всё равно занято больше 8GB.

RTX 3070. Разрешение 4k без DLSS. Как я и писал, карта высрала свои внутренности. Неиграбельное слайд-шоу по понятным причинам.

Едем дальше и меняем ВПП.

RTX 4070 Ti. Разрешение 2k без DLSS. Замечу, что и 12GB видеопамяти игре мало, что всем итак известно. Однако же, 60+ фпс и стабильная работа игры в течение всего вступления.

RTX 4070 Ti. Разрешение 2k с DLSS. 100+ фпс и абсолютно стабильная игра.

RTX 4070 Ti. Разрешение 4k без DLSS. Игра не запустилась ни разу. Несколько попыток и каждый раз вылет на загрузке, оценить уровень картинки не смог. Главная причина: игра просит в этом разрешении более 13 GB видеопамяти.

RTX 4070 Ti. Разрешение 4k с DLSS. Только в этом разрешении в верхней части с полоской требуемого количества видеопамят игра рисует, что DLSS даунскейлит картинку до 2k и далее дорисовывает кадры. А это значит, что мы поднимаемся по тексту вверх и видим результат, который мне выдало аналогичное нативное разрешение.

Не согласен. Зачем мне брать прожёрливую по части потребления электроэнергии, горячую видеокарту без поддержки DLSS3, если есть карта с потенциалом разгона (и даже в стоке немного разогнанная вендором), которая во всём обходит её?

Резонно, что выбор падает на 40хх серию. Да, можно было посмотреть на 4080, но в дело вступили ещё и финансы. Я увидел ценник в 79500 за IChill и не стал дальше думать.

Ну, я всегда беру “ ti “ )

@Mr_Simon я только не понял почему в 4k на 4070ti не запустилось, если даже 3070 что-то да выдаёт.

Cомневаюсь, что вылеты из-за нехватки vram, и первые два теста с 3070, это косвенно подтверждают.

Что-то я не понял. То вы пишите, что она не выдаёт 60, да и ещё стабильных фпс. То, получается, она уже 100+, причём стабильных выдаёт. Патч, так помог?

PS: И не GTX, а RTX.

Шел 2100 какой-то там год, вся мировая общественность была уверена( и сама SONY это подтвердила, прилюдно извинившись и попросив прощения, встав на колени), что ПК-порт The Last of Us Part 1 был убогим и кривым и только лишь один персонаж с форума ZoG продолжал утверждать, что он был идеален.

Полагаю все же DLSS.

Мне плевать, кто там и перед кем извиняется, я уже писал, но повторюсь - на моей системе работает идеально(точка). Можешь не верить, дело твоё, но мне здесь, да и по жизни в общем, врать или преувеличивать резона нету.

Друг еще бы она у нас не шла идеально. Но с такими системам нас 0.3 % стима. Так, что порт лютое ….

Ну и хорошо идет, в нее и на стим деке можно играть, но это ж не значит, что по эстетике это близко к ps 5. Про слабые системы.

Так для очень богатых 4090 же. Поставил себе и радуюсь. Но буду честен ни за что бы не купил если бы не кидок со стороны Сони. Для всего остального мне хватает моего mac book. Разве, что с fpga не поиграться, драйверов под arm нет.

А какой смысл покупать 3080ti при паритете в цене? В 4070ti хотя бы dlss 3 и в целом она по мощнее. Ну и у нее выше производительность с RT, потому, что больше этих самых RT блоков. Холоднее, тише, энергоэффективнее. Да и 12 гб на пару лет должно еще хватить, просто кто-то очень криворукий. А самый графонистый графоний в лице реквиема потребляет всего 8 гб.

Я в общем и не спорю, если у большинства идёт плохо, вылетает там и тд. то понятно, что порт говно. Но я всё же считаю, что это не худший порт, это не “Каллисто”, где fps проседает в определённых моментах\местах до 45fps, независимо от железа и разрешения, что напрямую мешало получать удовольствие от игры. Здесь хотя бы, при наличии хорошего железа, можно по полной насладится игрой и на 100% забыть о каких-то косяках оптимизации.

Меня только нагрузка на ЦП напрягает, уж сильно она высока, несоизмеримо тому, что происходит на экране. А так подтверждаю стабильные 120 в 3440x1440. Без dlss.

Из последнего еще wo long дал жару. Протокол гавнисто я скипнул. Поэтому не берусь судить.

А чего напрягаться то? Ну да, она здесь повыше, чем в том же Анче или ГоВе. У меня напр. проц на 50-60% загружен, а ядра в среднем на 60-80, температура около 70-ти вертится, так что вообще на это внимание не обращаю.

Представляю, чтобы было c процами, если бы в эти игры ещё и денуво пихали.

эта “оптимизация” защищает лучше любой денувы)

Я немного в Wu long поиграл, вроде ни чё такого не заметил, там же ограничение на 60 стоит. Единственное, картинка не плавная почему-то.

Cмешно )

А я и не говорил, что ему надо было брать 3080ti. Я как раз имел в виду, что разница не такая большая словно с 3070 на 3080ti перейти. Взял тогда хотя бы 4080 там и памяти 16 ГБ хватило и на 4К разрешение в TLOU.

так себе подход теперь. разница между 3090 и 3090ти в рамках погрешности, но 3090ти вышла под закат поколения, через полгода уже выпустили 4090 которая практически х2 сделала по скорости по тому же ценнику что за 3090ти просили. так что лучше уж тогда 5090 дождаться она явно будет хотя бы процентов на 50 лучше чем 4090ти

Понял, но все равно не понимаю этого мува с 4к геймингом, играю на ultrawide и на мой взгляд это лучший игровой опыт по сравнению с 16:9 матрицами.

Не нравиться мне ultrawide, т.к. они все курвы. Я сейчас на 50” 4К ТВ.

@Deadoutx @CyberEssence не хочу ни ultrawide, ни курву, просто хочется купить 32” fald c подходящими характеристиками. Последний раз монитор менял в 2018-ом, обошёлся в 200+, и до сих пор верой и правдой, просто 27” уже поднадоели, хочется на 32” пересесть.

Qled?

Нет, обычный fald. Просто на то время, это был первый моник с такими характеристиками(Asus PG27UQ)

А подожди… Да, там вроде чё то в описании было про qled, уже из головы вылетело.

Я просто помню, что первые мониторы на квантовых точках стоили так дорого.

Тип подсветки Qled указано:

https://www.dns-shop.ru/product/f4111a11f1923330/27-monitor-asus-rog-swift-pg27uq-seryj/characteristics/

Но я этот моник вообще не из-за точек взял - что они есть, что нет… Взял, именно из-за 4k120 и fald, на hdr также пофиг.

Да, и это меня немного сбило с толку даже. Но запустить игру на более свежей видюхе я не могу. Она просто вылетает сразу после окончания вступительного ролика.

Не все, но в 90 %. Конечно если вы с графикой, чертежами или моделями работает то вам курва противопоказана. Большой ТВ у меня тоже есть для сосолей. Я правда жалею, что купил 65” а не 75”. Но толи еще будет, сделаем ремонт повешу в спальне.

Вы наверное такой себе хотите?

https://www.dns-shop.ru/product/31e4dc0003f2c823/32-monitor-asus-rog-swift-pg32uqx-cernyj/

В точку )) к сожалению, позволить не могу.

)) к сожалению, позволить не могу.

Видимо там памяти больше. У меня 3060. 12гб и все норм но игра съела почти всю память а на 3070 стоит 8 Гб что типо мало. Получается, что карта мощнее, но из за памяти текстуры вообще не лезут даже в 1080р. если играть.

Три дня назад прошел всю игру и дополнение Рязань 5600 и 3060 12gb в фулХД все на ультра без dlss. Залочил на 50 ФПС чтоб не скакали. Не было ни одного глюка, что странно, кроме двух вылетов за все прохождение. Порт кривущий, но мне видимо пропёрло просто.) Если кто-то файл подкачки отрубал на диске С то возвращайте по умолчанию. Игра забивает гигов 10 там зачем-то.